Android平台语音服务功能的开发毕业论文

2020-03-24 15:24:53

摘 要

随着语音技术的成熟,人们逐渐将目光聚焦于语音,基于语音的服务系统也受到了极大关注,语音助手也取得了不断突破和不断完善,为人们提供了更多更好的服务,使人们能更方便更简单地操控手机。

本文阐述的Android平台语音服务功能的开发借助目前主流的语音开发平台讯飞语音云进行开发,通过与讯飞语音云进行交互,从而识别用户语音,为用户提供各种服务,达到解放双手简化手机操作和方便视觉障碍人士更好地使用手机的目的。

论文主要阐述了语音服务系统的需求分析,介绍了系统主要的功能,对系统各个功能模块的设计与实现思路进行了说明,同时对主要采用的关键语音技术也进行了简要介绍。

系统采用的是当前主流的语音开发平台,语音识别率高,提供多种功能,服务性良好,对某些私密数据数据采用MD5加密,安全性高。

关键词:讯飞语音云;语音系统;语音助手;视觉障碍人士

Abstract

With the maturity of voice technology, people gradually focus on voice. Systems of service based on voice have also received great attention. Voice assistants have also made continuous breakthroughs and continuous improvement. They all have provided people with more and better services, and it’s more convenient and easier for people to control the phone.

The development system of the Android platform's voice service function described in this article is developed with the current mainstream voice development platform, Xunfei voice cloud, and interacts with the Xunfei voice cloud to identify user voices and provides users with various services to achieve liberation. As well as, it’s convenient for visually impaired people to use mobile phones better.

The paper mainly expounds the demand analysis of the speech service system, introduces the main function of the system, explains the design and implementation ideas of each functional module, and also briefly introduces the key speech technology mainly adopted.

The system adopts the current mainstream speech development platform, so it has a high rate of speech recognition. As the meantime, the system provides multiple functions, and it has good serviceability. MD5 encryption is used for some private data and the security is high.

Key Words: Xunfei speech cloud;voice system;voice assistant;visually impaired person

目录

1绪论 1

1.1目的和意义 1

1.2国内外研究现状 1

1.3研究内容和目标 2

2系统需求分析及技术简介 3

2.1需求分析 3

2.2语音技术简介 3

2.2.1语音技术比较 3

2.2.2核心技术介绍 4

3系统设计 5

3.1 系统数据流图 5

3.2系统功能模块 5

3.3系统流程设计 6

3.3.1拨打电话 6

3.3.2发送短信 7

3.3.3音乐搜索播放 7

3.3.4百科搜索 8

3.3.5新闻搜索 9

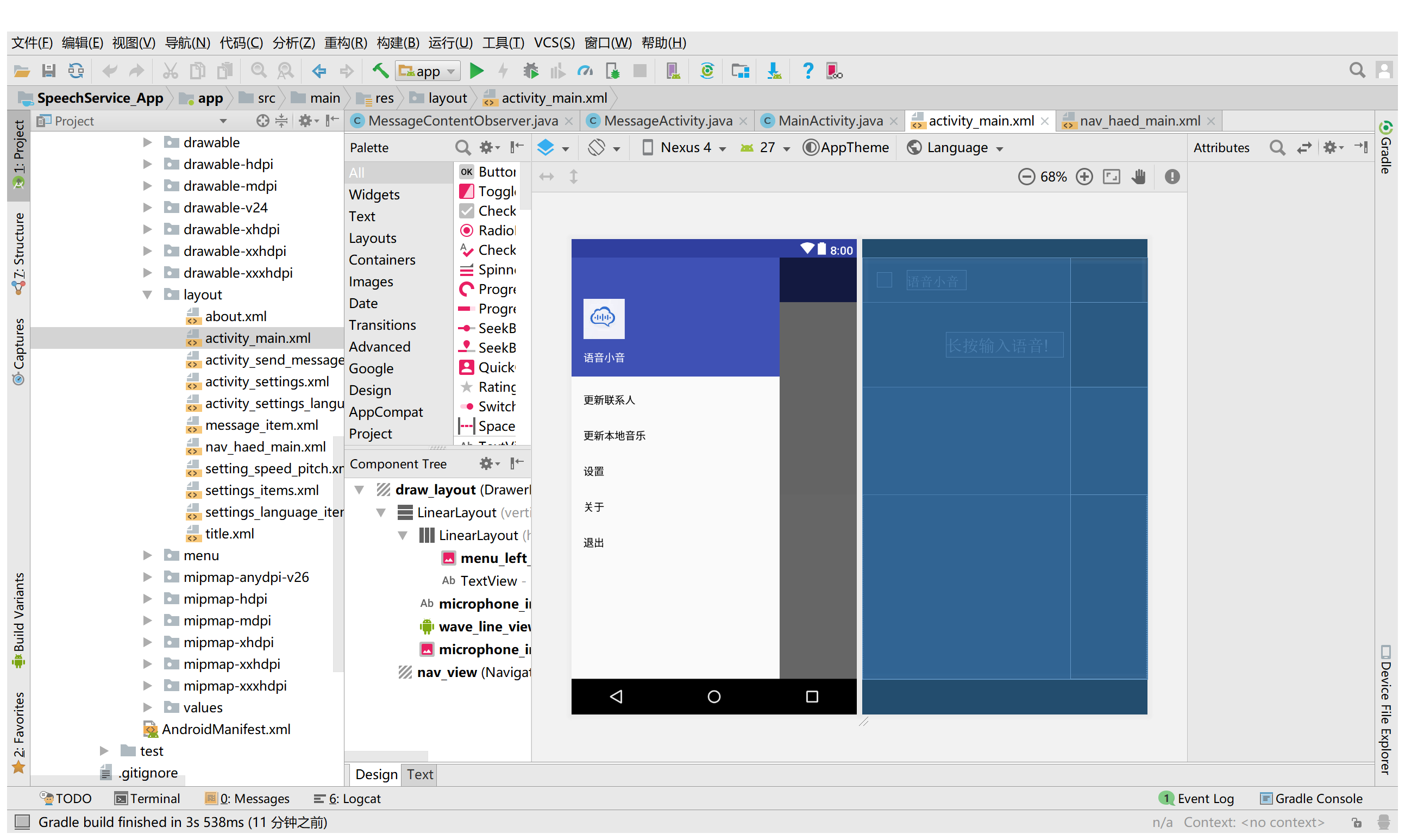

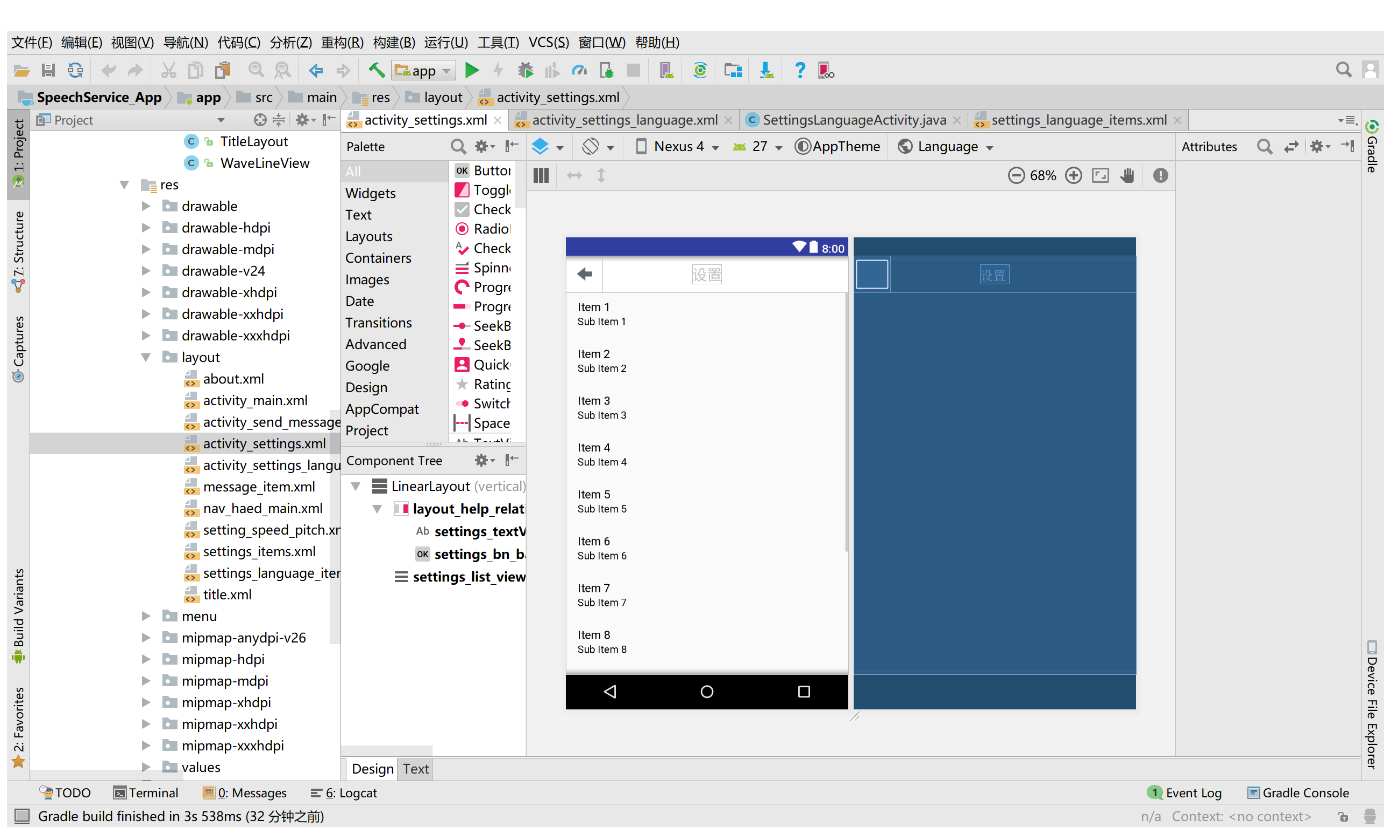

3.4界面设计 10

3.4.1主界面设计 10

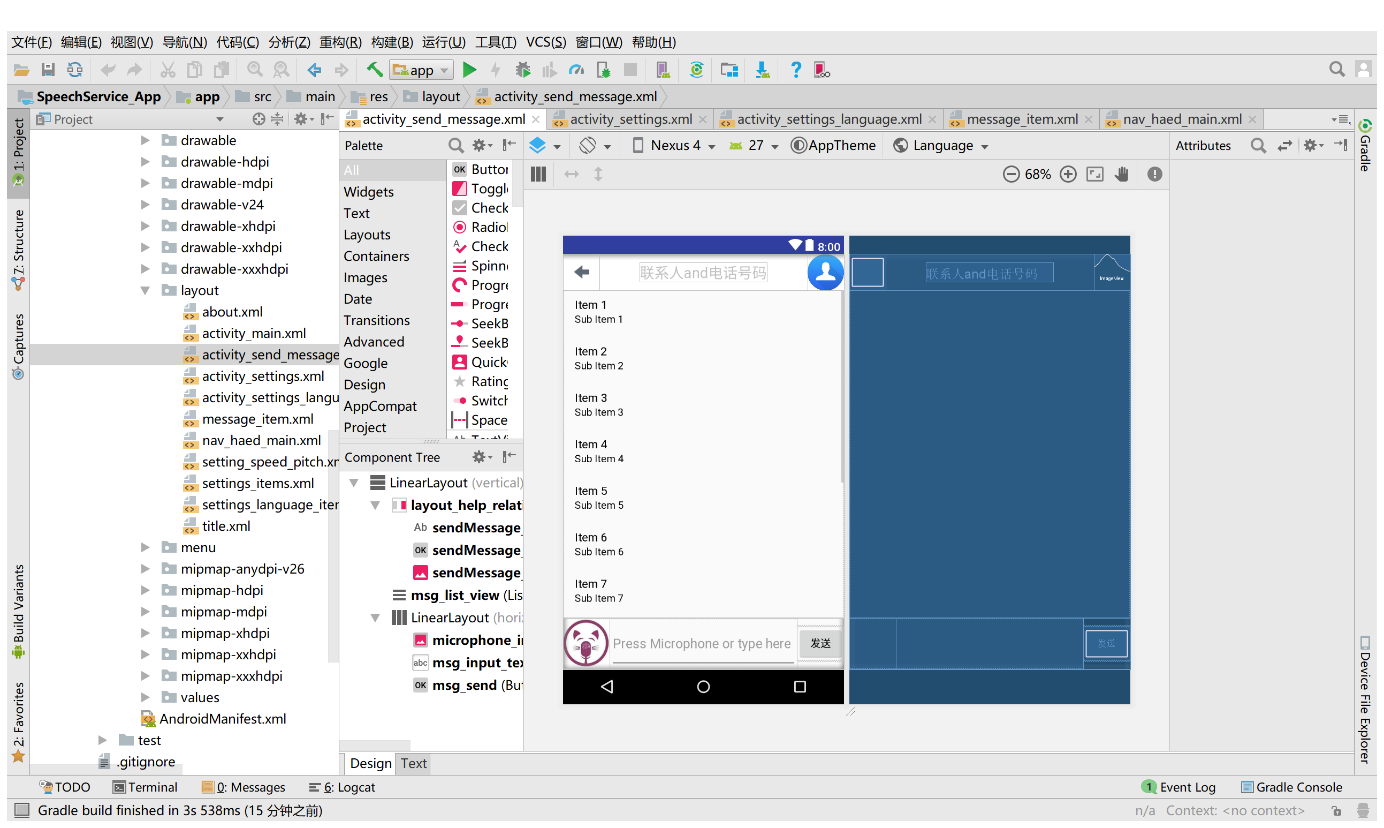

3.4.2短信发送界面设计 11

3.4.3 设置界面设计 11

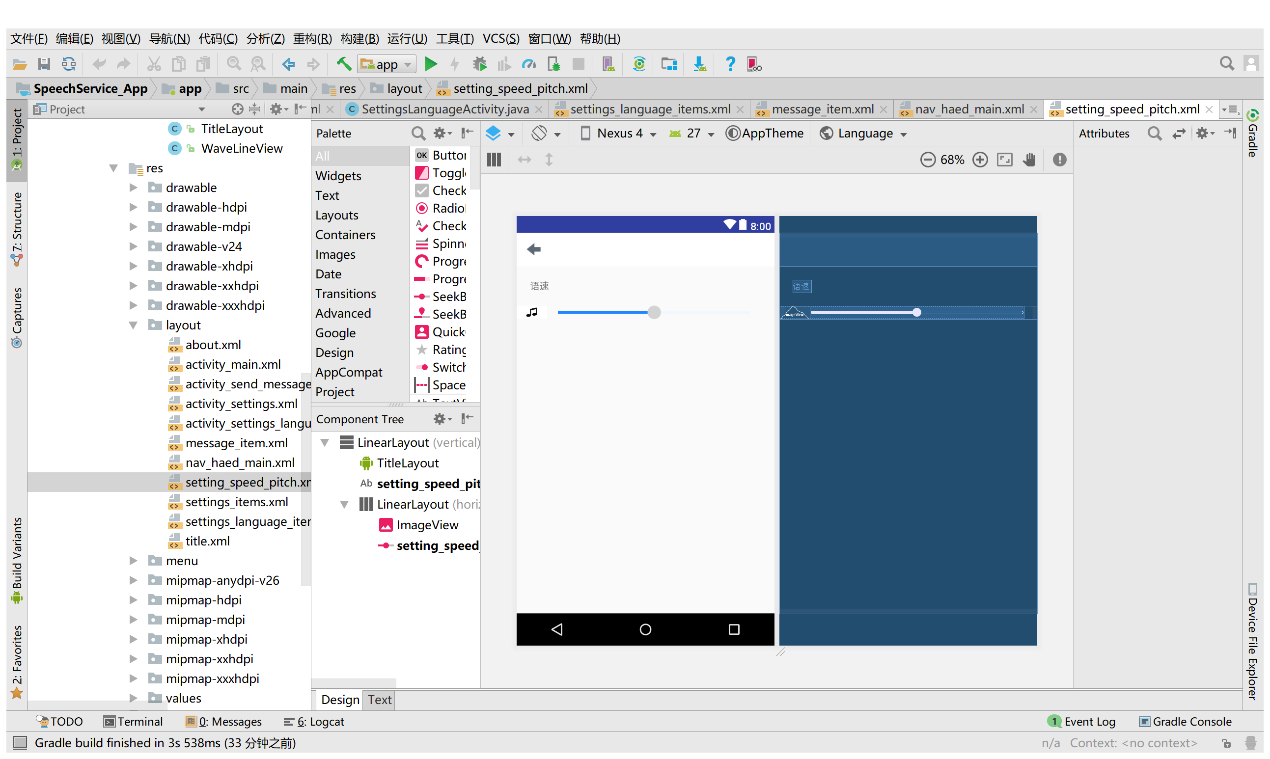

3.4.4 语言选择界面设计 12

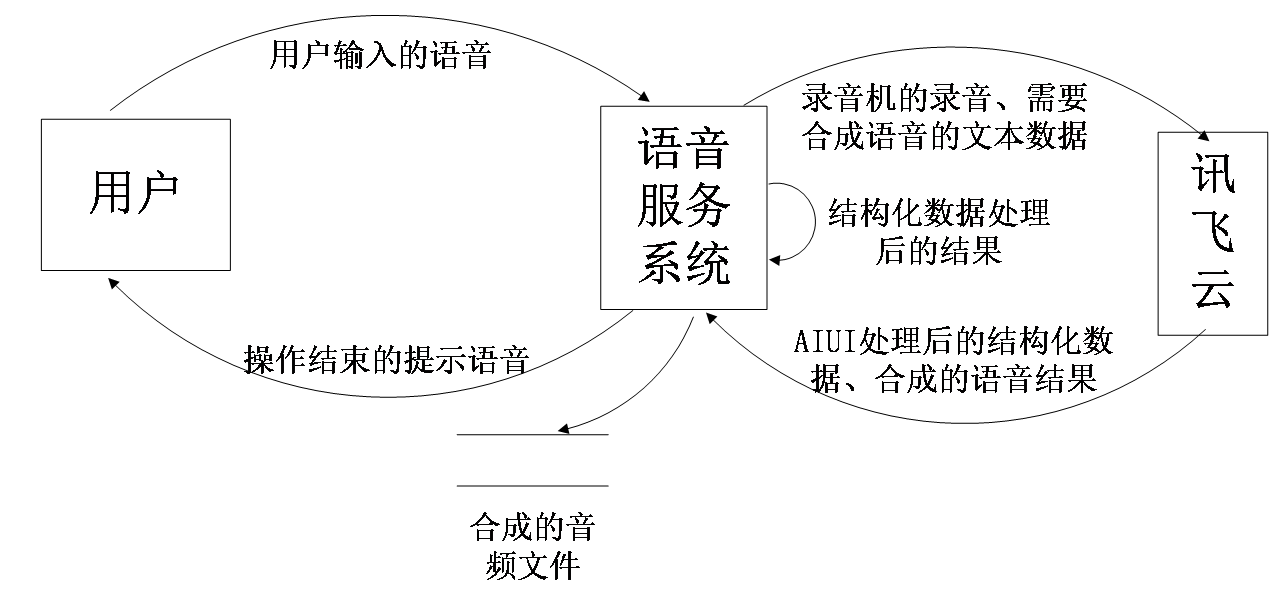

3.4.5播放速度选择界面设计 12

3.5技能设计 13

3.5.1短信技能设计 13

3.5.2本地音乐播放技能设计 14

4系统实现和测试 15

4.1基于讯飞技术的核心模块的设计与实现 15

4.1.1基于讯飞技术的语义理解模块设计与实现 15

4.1.2基于讯飞技术的语音合成模块设计与实现 18

4.1.3基于讯飞技术的语音听写模块设计与实现 20

4.2系统主要功能的设计与实现 21

4.2.1拨打电话功能的设计与实现 22

4.2.2发送短信功能的设计与实现 23

4.2.3搜索播放本地音乐功能的设计与实现 25

4.2.4搜索播放网络在线音乐功能的设计与实现 26

4.2.5百科搜索功能的设计与实现 31

4.2.6新闻播报功能的设计与实现 31

4.3 系统测试 32

5总结 36

参考文献 38

致 谢 39

1绪论

1.1目的和意义

随着网络时代的到来与繁荣,Android在全球的市场份额已跃居全球第一[1],手机变得极其普遍,为了简化和方便人们对手机的使用,帮助具有视觉障碍和其他功能性障碍的人使用手机,在手机上开发语音服务功能便显得极为重要。且在日常生活中往往存在着某些特定情景,无法及时使用双手对手机进行操控,而只能依靠语音来与手机交流沟通。譬如在驾驶汽车过程中如遇紧急电话需要接听或紧急短信需要回复的情况时,如若可以通过语音来对手机进行操作,便能大大减小发生车祸的隐患,有利于社会稳定与和谐。针对某些具有视觉障碍功能的特点人群而言,Android平台的语音服务功能带来的好处更加无法忽视。

与早期对手机的传统操作(实体按键操控、触屏)相比,语音控制有其独特的优势。实体按键所具有的物理特性无法改变,其大大减小了屏占比,影响用户的体验,扩展性差,无法升级和改变,且它也无法随着APP的不同而发生对应的变化。而针对目前主流的触屏操控而言,依旧无法解放双手。现如今随着语音技术的发展,它逐渐应用于市场,语音操控手机成为了现实,语音服务助手也应运而生。语音识别是人工智能的一个分支,属于多维模式识别的范畴[2],语音服务功能是为人工智能服务的,Android平台的语音服务功能的开发是当前语音技术的应用市场的一个产物,它标志着语音技术已基本趋于成熟,它也标志人工智能能很好适应市场。语音技术在各种技术以及研究人员的推进下,将完成更复杂的操作,未来对手机的控制将被语音所代替,将“至繁归于至简”。

1.2国内外研究现状

语音作为交流与通信最为简单与便捷的方式之一[3],一直以来便是一个重要的研究领域。关于语音识别技术的研究最早起源于上世纪50年代,最初由贝尔实验室研究,此时的研究只是对简单的孤立词进行语音识别。直至上世纪80年代,随着隐马尔科夫模型(HMM)以及NGram语言模型的应用,语音识别转向了大量词汇的连续语音识别,诸如李开复基于GMM-HMM的语音识别框架研发的SPHINX系统。辛顿(Hinton)于2006年提出深度置信网络(DBN)后,基于DNN-HMM的语音识别系统得到发展。而关于语音合成的研究也已经有将近两百年的历史了,早期的语音合成研究主要是采用参数合成方法,有Holmes的并联共振峰合成器(1973)和Klatt的串/并联共振峰合成器(1980)。八十年代末期,基音同步叠加(PSOLA)方法得到了提出(1990),从而使得合成的语音的自然度和音色得到了提高。九十年代初,基于PSOLA技术的法语、德语、英语、日语等多个语种的文语转换系统研制成功。最近几年,人们逐渐开始将注意力转向了数据库的方向。而我国的关于语音合成方面的研究起步比较晚,但也经历了共振峰合成、LPC合成至PSOLA技术应用这几个阶段,语音合成技术得到了很大的发展。在自然交互家平台方面,我国已取得了突破性进展,2010年,科大讯飞发布了首个同时集成语音合成、语音搜索、语音听写等能力的语音交互平台——“讯飞语音云”;2011年,又增加了个性化语音识别功能,可对口音和专有词汇进行训练,俞栋、邓力等研究发表关于在语音识别上使用深度神经网络的文章,使得大词汇量对连续语音识别获得突破性进展[4];2012年,将DNN技术应用于语音云平台,引入了自然语音理解和声纹识别等扩展能力;2013年,在手机终端实现了离线语音听写;2014年,发布高抗噪识别和方言识别[5]。讯飞也开放了其语音接口,“讯飞语音云”的提出为开发者提供了一个更开放的语音功能开发平台,为未来智能语音提供了无限可能,增添了无限精彩[6]。

在语音领域,Nuance获得了突出成就,苹果的Siri、三星的S-Voice均采用的是Nurance技术,微软、谷歌作为后起之秀,其识别率现已超越Siri,而Echo也已成为了语音控制的人工智能入口。而纵观国内语音领域,语音识别也得到突飞猛进,语音识别领域成就以科大讯飞和百度语音的成就最为突出,其他诸如搜狗输入法、腾讯、微信、阿里、爱奇艺、360等均也建立了各自的语音识别引擎。随着人工智能的火热推进,语音领域也将不断发展。

1.3研究内容和目标

有视觉障碍和其他功能障碍的人,在使用手机时会很困难。在手机上开发语音服务功能能够极大地方便具有功能障碍的人群,帮助他们使用手机。同时,为了提高手机的实用性,方便人们对手机的操作,简化人机交互方式,需要在手机上进行语音服务功能的开发。本项目以语音合成和语音识别技术为基础,使用Android的开发平台与环境,采用支持Android平台的语音处理系统(讯飞语音云),目标是开发支持Andriod平台上的语音服务功能,完成Android平台下的语音服务功能开发,达到反应速度快、高实时性、高效性、良好保密性和方便用户操作的目标[7]。

2系统需求分析及技术简介

2.1需求分析

系统主要实现的语音服务功能应有:1)语音拨打电话和语音控制电话的接听与挂断;2)语音控制收发短信、播报收到的短信内容;3)语音控制搜索、播放本地音乐和在线音乐,语音控制音乐的播放(如暂停、下一曲等);4)语音进行百科搜索,播放新闻,语音控制新闻的播放;5)用户可与系统进行简单的聊天对话。

研究设计的系统主要面向的人群是具有视觉障碍和其他功能障碍的特殊人群,他们不能通过识别手机上的内容来操作手机,只能通过语音,故系统需要完成当用户通过语音向手机发号指令时,手机能及时完成用户需要完成的动作的功能,语音反馈给用户操作的结果。关于数据处理方面(如联系人的更新、本地音乐的更新)应具有实时性和保密性,用户的信息不对外公开,只对当前用户有效。且系统应具有良好的健壮性,能正确处理错误数据和错误操作,正确操作的处理过程应清晰、简单,不含过多的复杂操作。

由于系统流程的进行是由语音引导控制的,人机交互过程也是依靠语音进行的,故系统的设计和实现与语音技术密不可分,系统需要识别出用户的语音内容,并通过语音将操作结果反馈给用户,语音技术的运用遍及了系统操作整个流程。

2.2语音技术简介

2.2.1语音技术比较

语音技术是人际交互信息最自然的方式[8],当前国内如科大讯飞、百度语音、搜狗输入法、腾讯、微信、阿里、爱奇艺、360等均搭建了各自的语音识别引擎,其中以科大讯飞和百度语音的成就最为突出。两者均提供了语音识别(包括语音理解协议)和语音合成的服务,且百度语音的所有服务均免费提供给开发者,科大讯飞所有在线服务免费提供,两者均开源各有其优势。

百度语音为开发者提供了完全永久免费的服务,且SDK可以根据当前网络状况和指令类型来自动选择是采用本地引擎还是云端引擎,在既提供了良好的识别速度的同时也节省了流量,且可以根据需要自行上传预料和训练模型,从而提高识别率。对于科大讯飞,其提供了免费的在线服务,可自定义识别场景,提高用户的识别率。相比百度语音,它还提供了语音听写和问答库的服务,可将语音直接转换成文字,还可满足用户的闲聊需要。开发者还可自定义问答库,来更好地完善聊天服务。总的来说,两者各有优势,但百度语音倾向于人工智能领域,而科大讯飞专攻于语音领域,故在系统开发中使用科大讯飞的SDK帮助开发。

2.2.2核心技术介绍

在Android平台语音服务功能开发中,主要用到了科大讯飞的三个语音服务,包括AIUI语义理解服务、在线语音听写服务和在线语音合成服务。

AIUI语义理解是科大讯飞提供的解决人机智能交互问题的一套方案,AIUI 开放平台主要包含了语义技能(Skill)和问答库(Qamp;A)等的编辑,提供了开放的语义技能和开放问答库,同时开发者也可自定义场景、技能和自定义问答库,更好完成应用所需功能。同时支持热词上传,词条的上传,提高语音的识别率。AIUI依赖于AIUI 语义理解引擎,核心功能是将一句自然语言转换成结构化数据,开发者可根据AIUI语义协议使用返回的数据。AIUI也支持Android、iOS、Linux、Windows 多多个平台接入,支持SDK、硬件接入、HTTP 协议的方式多种方式的接入。在此语音服务功能开发系统中,采用的是Android平台的SDK接入方式。

语音合成接口可以将文本信息转换成语音信息[9],在线语音听写可将语音输入直接转换成文本,支持多种听写模型,商旅而听写、音乐听写和视频听写等,可用于社交聊天、语音输入法、人机交互多种场景,其识别率已超过98%,支持中文、英文两个语种的识别,还提供粤语、河南话、四川话等方言的识别,运行效率高识别结果响应时间不高于200ms,且可建立用户个性化词条,提高识别的准确率。同时,MSC SDK 还提供了录音交互的对话框控件,方便与用户进行交互。

在线语音合成是将文字信息转化为可以听到的声音信息,让机器像人一样发出声音开口说话。讯飞在线语音合成的音频的十分自然和清晰,音频的清晰度也已经超过了普通人的朗读发声水平,提供中文英文粤语等多语种、川豫多方言、支持男女声多风格的选择,也支持动态调整音量、语速、音高等参数——可自定义语音合成对象,且其运行资源占用空间小,在使用时可根据需求设置发音人的参数和合成音频的保存路径等。

3系统设计

3.1 系统数据流图

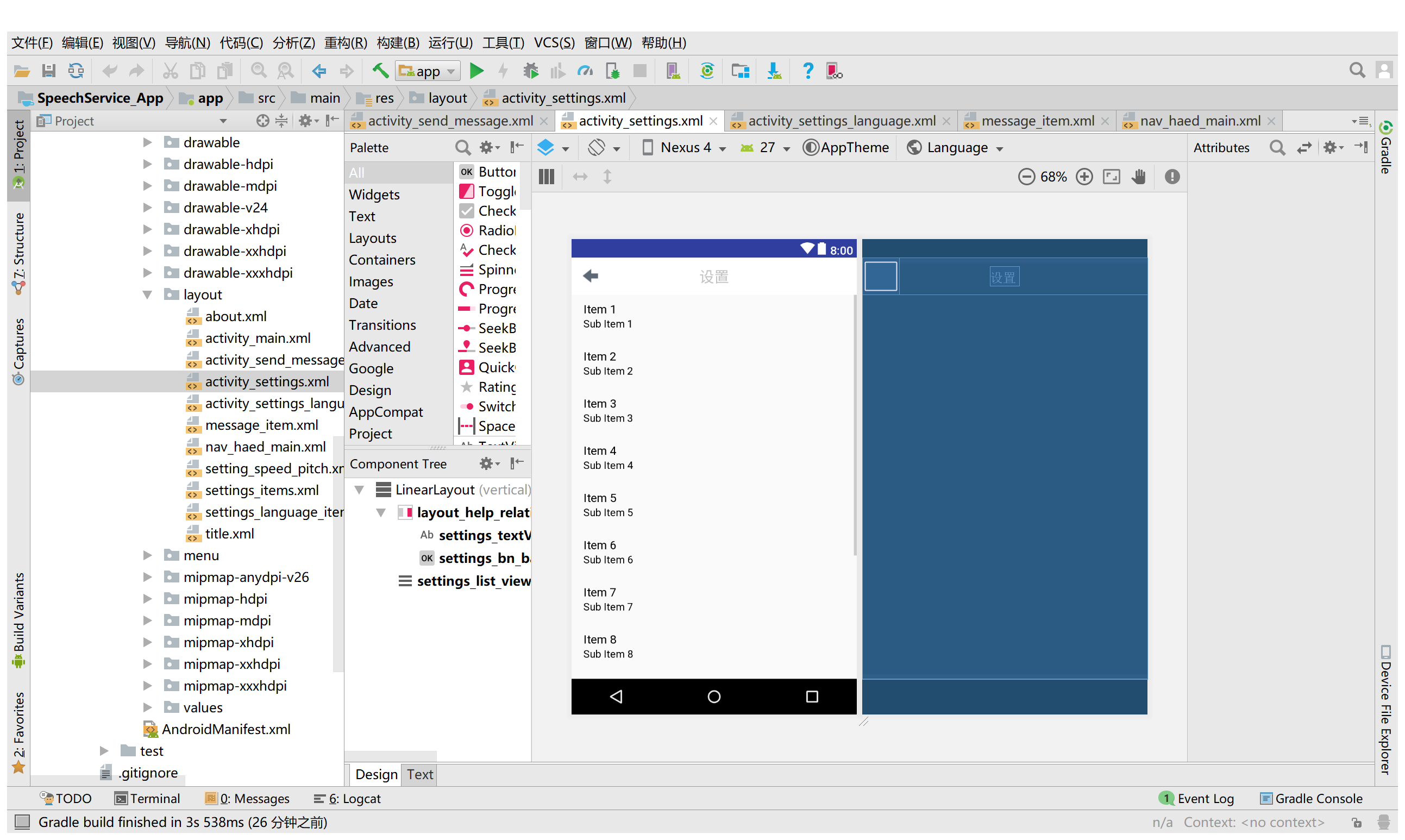

图3.1 系统数据流图

3.2系统功能模块

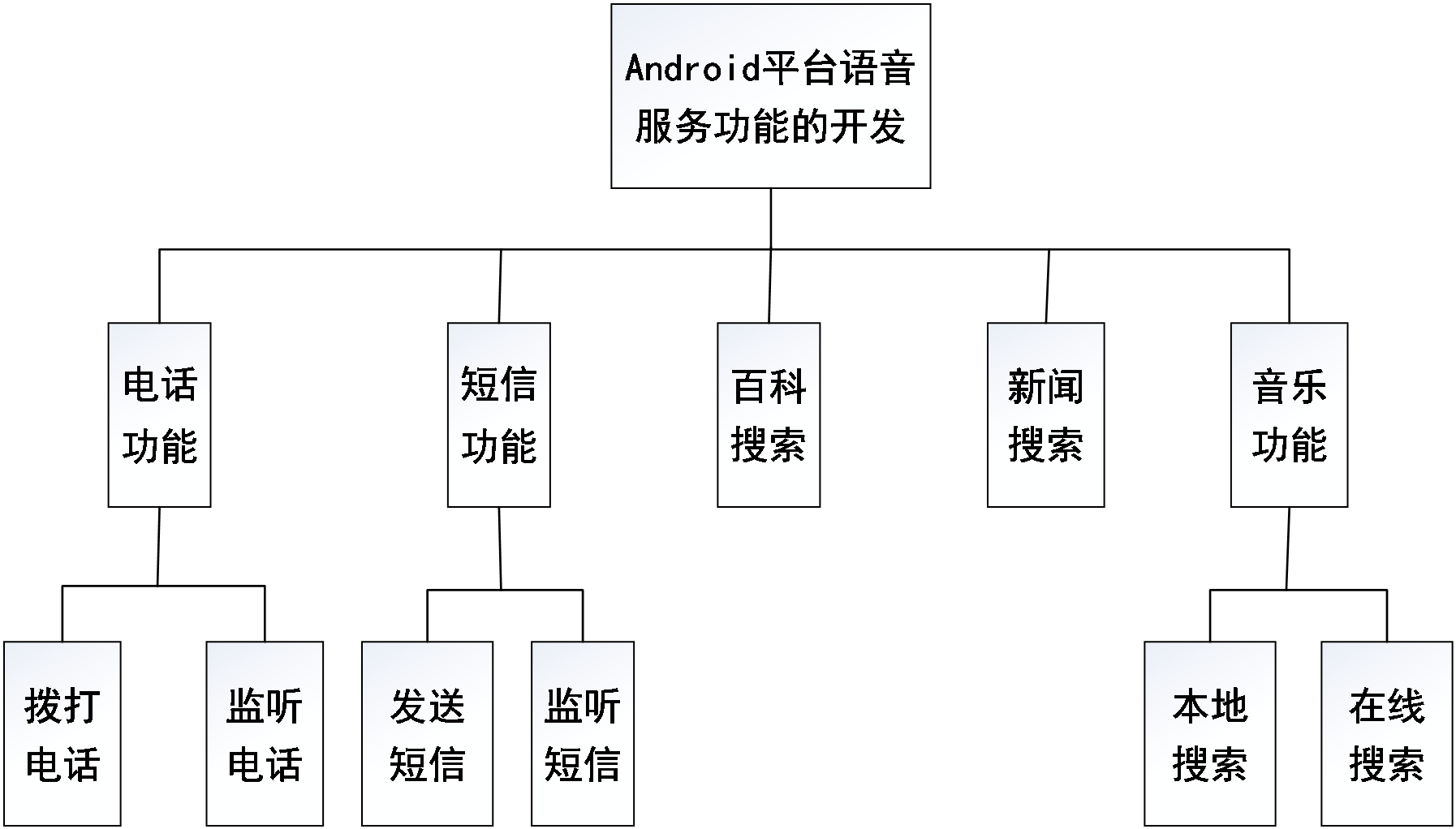

Android平台语音服务功能系统主要分为5个功能模块,包括基于语音的电话功能、基于语音的短信功能、语音控制的百科搜索、语音控制的新闻搜索和语音控制的音乐搜索和播放功能。电话功能模块又可分为语音控制的电话拨打模块和来电监听模块,短信功能模块又可分为语音控制的短信发送模块和收信监听模块,音乐功能模块可分为本地音乐语音搜索模块和在线音乐语音搜索模块。

图3.2 系统功能模块图

3.3系统流程设计

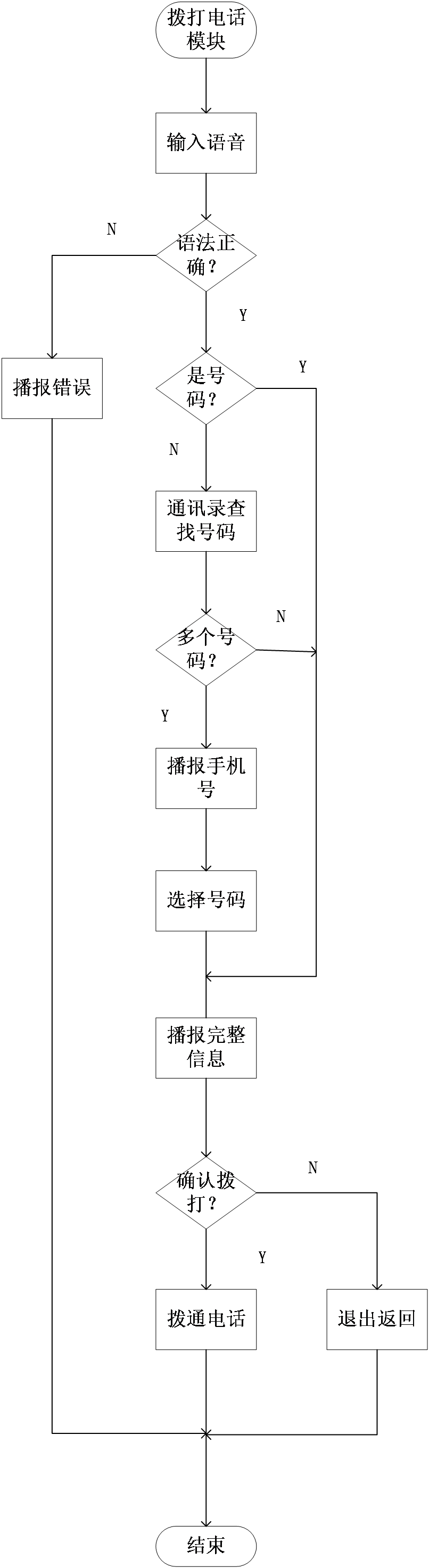

3.3.1拨打电话

用户通过语音完成语音拨打电话的操作,用户长按界面上的麦克风图标输入诸如“拨打电话给小明”的语音指令,系统首先通过讯飞语音理解接口进行语义识别,若语法错误系统将通过讯飞提供的语音合成接口直接通过语音提示用户“输入的语音语法有误,请重新输入语音”。若语法正确,系统将播报完整信息供用户确认,确认成功后,拨打指定联系人的电话。

图3.3 拨打电话流程图 图3.4 发送短信流程图

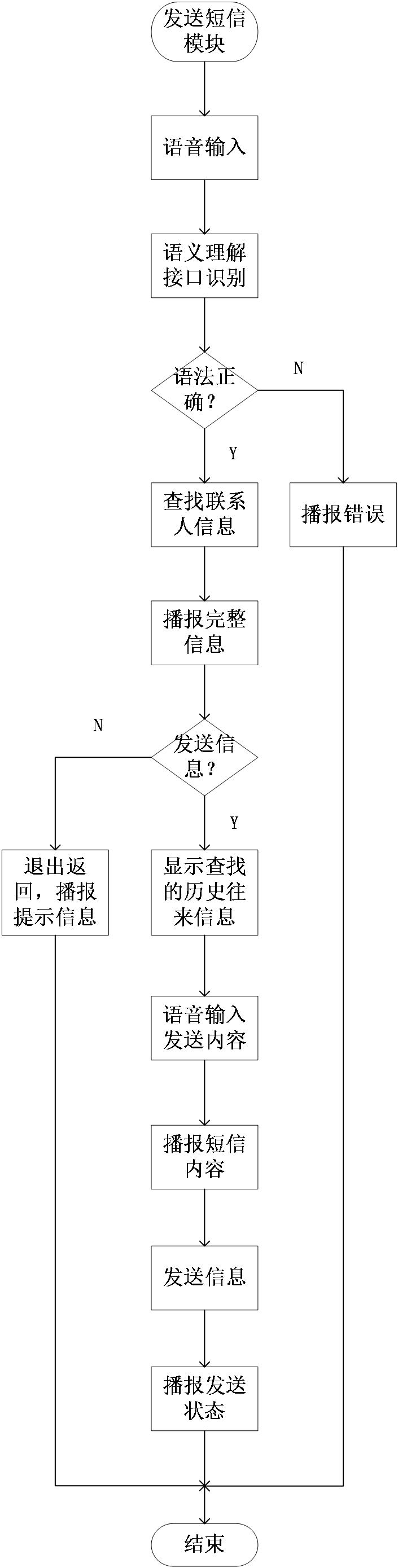

3.3.2发送短信

通过语音发送短信。用户语音输入诸如“发短信给小明”的指令,系统首先通过进行语义理解接口进行识别,若语法错误则直接语音提示用户“语法错误”,若语法满足要求,系统将在通讯录中查找该联系人,若找到该联系人,系统将语音播报给用户,供用户确认联系人信息,同时提示用户“请输入内容”,同时跳转到语音发送界面。在发送界面,用户点击输入内容按钮进行语音输入,每输入一段内容同时进行语音播报,输入完成后点击按钮发送,发送完成后将语音播报发送内容,详细流程见图3.4。

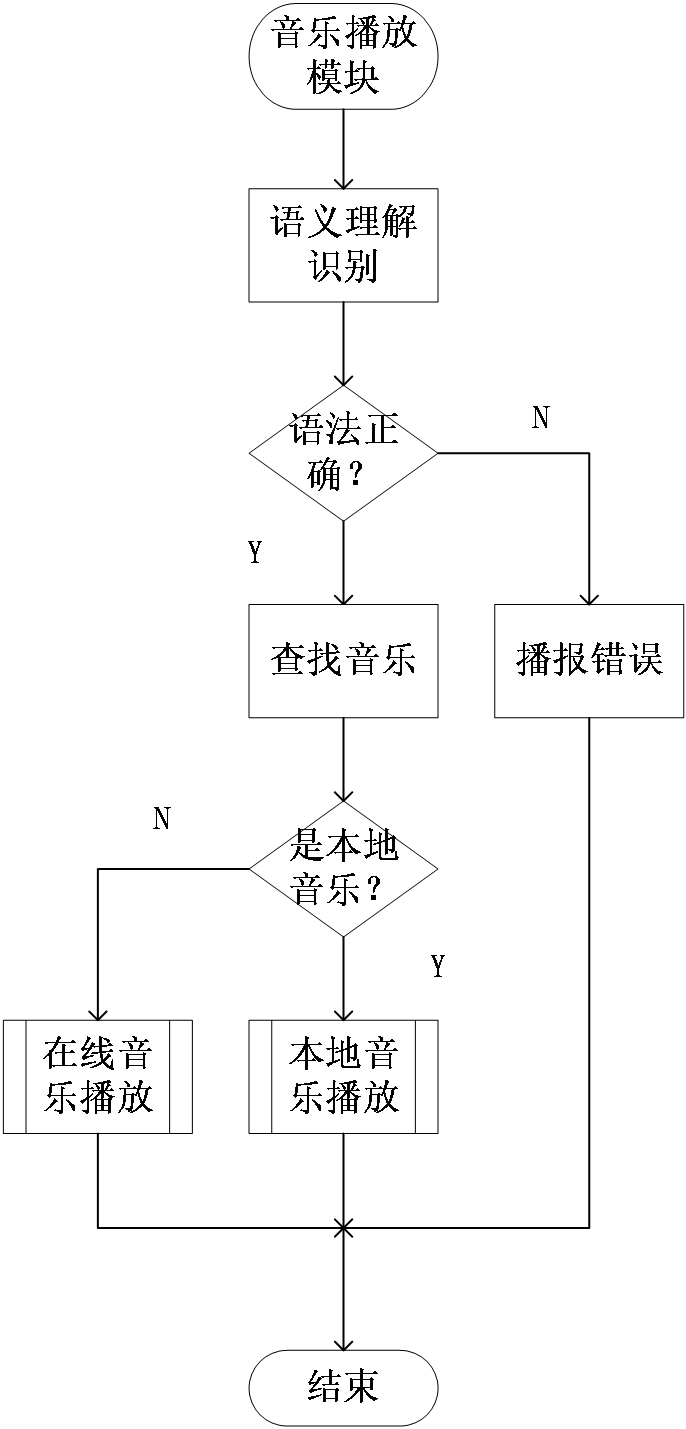

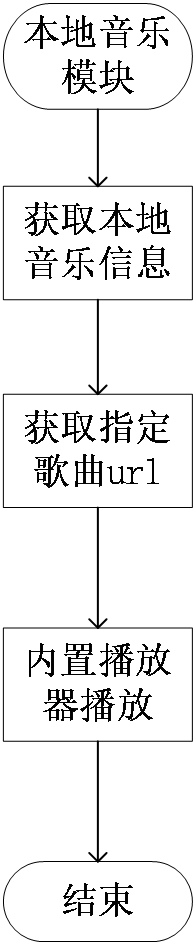

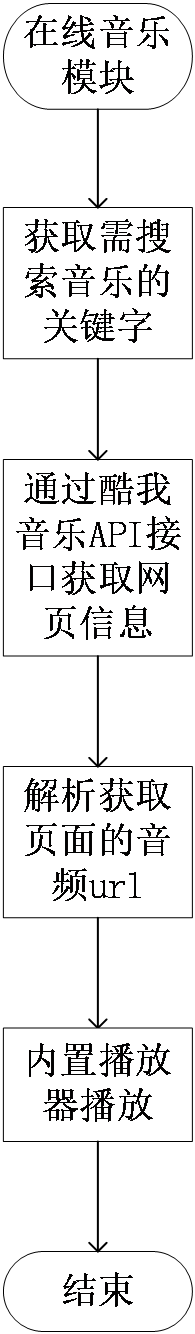

3.3.3音乐搜索播放

用户进行语音搜索和播放音乐。用户语音输入诸如“播放离人愁”的命令,系统将首先通过语义理解接口对输入的语音进行判断,若不满足语法要求,系统语音提示用户“语法错误”;若满足语法,系统将在本地歌曲列表中查找该歌曲,查找成功后直接播放歌曲;若未查找到指定歌曲,系统将根据关键字查找在线网络音乐进行播放。

图3.5 音乐搜索播放流程图

本地音乐播放流程图和在线音乐播放流程图:

图3.6 本地音乐播放流程图 图3.7 在线音乐播放流程图

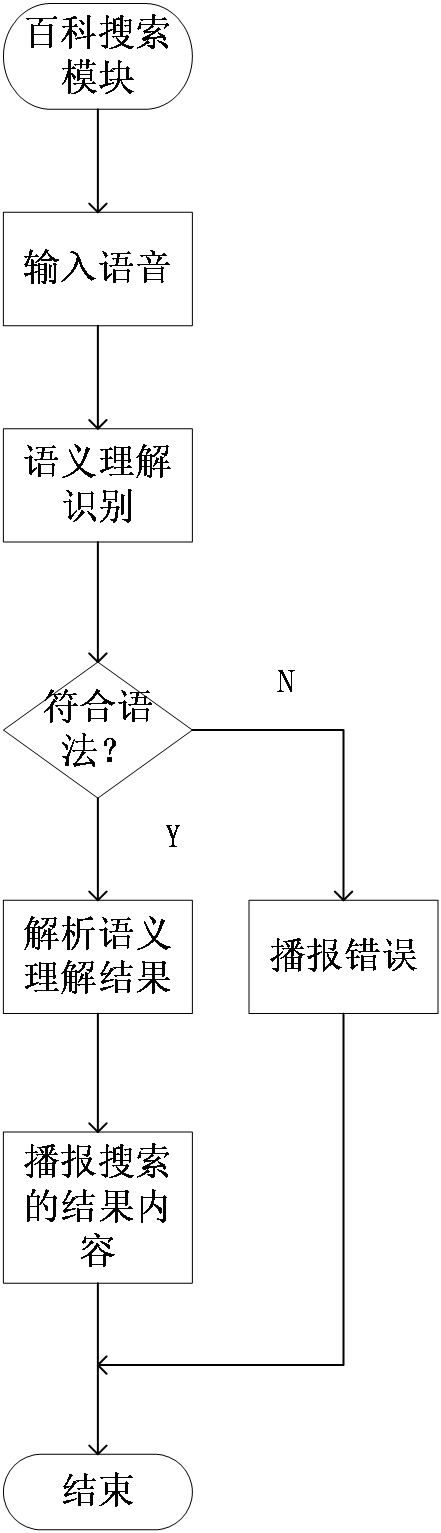

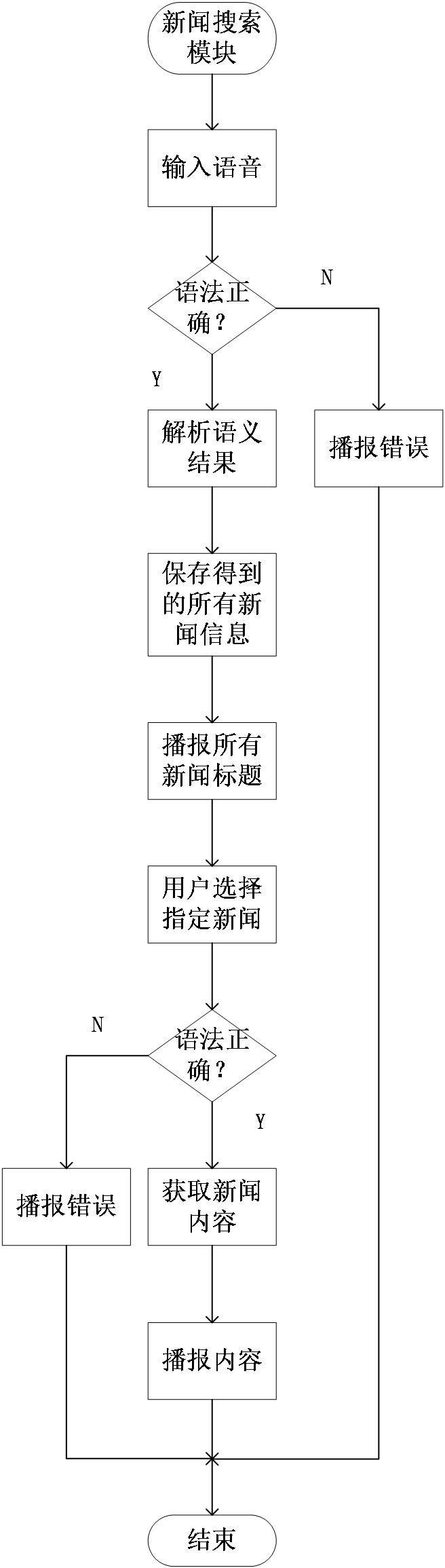

3.3.4百科搜索

用户语音完成百科搜索。用户语音输入诸如“百科搜索薛之谦”的命令,系统将首先通过语义理解接口对输入的语音进行判断,若不满足语法要求,系统语音提示用户“语法错误”;若满足语法,系统将对语义理解返回的结果进行解析,调用语音合成接口播报百科搜索到的内容,详细流程见图3.8。

3.3.5新闻搜索

以上是毕业论文大纲或资料介绍,该课题完整毕业论文、开题报告、任务书、程序设计、图纸设计等资料请添加微信获取,微信号:bysjorg。

相关图片展示: