基于多任务级联卷积网络的联合人脸检测和对齐外文翻译资料

2022-11-13 16:06:56

英语原文共 4 页,剩余内容已隐藏,支付完成后下载完整资料

20151309068-张佳垒-英文文献中文译文

基于多任务级联卷积网络的联合人脸检测和对齐

摘要:在不受约束的环境中,由于各种姿态、光照和干扰,人脸检测和对齐都是具有挑战性的。最近的研究表明,深度学习方法可以在这两个任务上取得令人印象深刻的表现。在这篇文章中,我们提出了一个深入级联的多任务框架,利用检测和对齐之间的内在关联来提高它们的性能。特别是,我们的框架利用了层叠式架构,通过精心设计的深度卷积网络的三个阶段,精确地预测人脸和关键点位置。此外,我们提出了一种新的在线硬样本挖掘策略,进一步提高了实际的性能。在具有挑战性的人脸检测数据集和基准库, WIDER FACE人脸检测基准库,以及户外人脸对齐基准库中标记人脸关键点方面,我们的方法取得了优于最新技术的精度,同时可以保持实时性能。

关键字:级联卷积神经网络(CNN),人脸对齐,人脸检测

1 介绍

人脸检测与对齐是人脸识别、面部表情分析等多种应用的基础。然而,面部的巨大视觉变化,如遮挡、大的姿态变化和极端的灯光,在现实应用中给这些任务带来了巨大的挑战。

Viola和Jones提出的级联人脸检测器利用Haar-Like特征和AdaBoost算法来训练级联分类器,实现了较好实时效率。但是,文献[1]、[3]、[4]等大量的工作表明,在现实应用中,这种检测器的效率可能会显著降低,因为即使有更高级的特征和分类器,人脸的视觉变化也会更大。除了级联结构,Mathias等人引入了可变形部分模型用于人脸检测,取得了显著的性能。然而,它们的计算成本很高,并且通常需要在训练阶段进行昂贵的标记。近年来,卷积神经网络(CNNs)在图像分类、人脸识别等计算机视觉任务中取得了显著的进展。受计算机视觉任务中深度学习方法的重大成功启发,一些研究利用深度网络进行人脸检测。Yang等人对人脸属性识别进行深度CNNs训练,获得人脸区域的高响应,进而产生人脸候选窗口。然而,由于CNN结构复杂,这种方法在实际应用中时间成本很高。Li等人使用级联CNNs进行人脸检测,但需要从人脸检测中进行边界框标定,需要额外的计算费用,忽略了人脸标志定位与边界框回归之间的内在相关性。

人脸对齐也引起了广泛的研究兴趣。该领域的研究工作大致可以分为两类,基于回归的方法和模板拟合方法。最近,Zhang等人提出将人脸属性识别作为辅助任务,利用深度CNN增强人脸对齐性能。

然而,以往大多数的人脸检测和人脸对齐方法都忽略了这两个任务之间的内在联系。虽然已有的一些工作试图共同解决这些问题,但这些工作仍然存在局限性。例如,Chen等人利用像素值差的特征与随机森林共同进行对齐和检测。但是,这些手工特征限制了它的性能。Zhang等人利用多任务CNN提高了多视点人脸检测的准确率,但检测召回受到弱人脸检测器产生的初始检测窗口的限制。

另一方面,训练中挖掘硬样品对于增强检测器的能力至关重要。然而,传统的硬样本挖掘通常以离线方式进行,这大大增加了人工操作。设计一种面部检测的在线硬样本挖掘方法是可取的,它可以自动适应当前的训练状态。

在本文中,我们提出了一个新的框架,利用统一级联卷积神经网络(CNNs),通过多任务学习来整合这两个任务。所提出的CNNs包括三个阶段。在第一阶段,它通过一个浅CNN快速生成候选窗口。然后,通过一个更复杂的CNN,它通过拒绝大量的非正面窗口来改进窗口。最后,它使用一个更强大的CNN再次提炼结果,并输出五个人脸关键点位置。通过这种多任务学习框架,可以显著提高算法的性能。本文的主要贡献总结如下:

- 我们提出了一种新的基于级联CNNs的联合人脸检测与对齐框架,并仔细设计了基于实时性能的轻量级CNN架构。

- 我们提出了一种有效的在线硬样本挖掘方法来提高性能。

- 我们在具挑战性的基准库中进行了广泛的实验,以显示与最新人脸检测和人脸对齐技术相比,所提出的方法有显著的性能改善。

2 方法

在本节中,我们将描述联合人脸检测和对齐的方法。

A. 总体框架

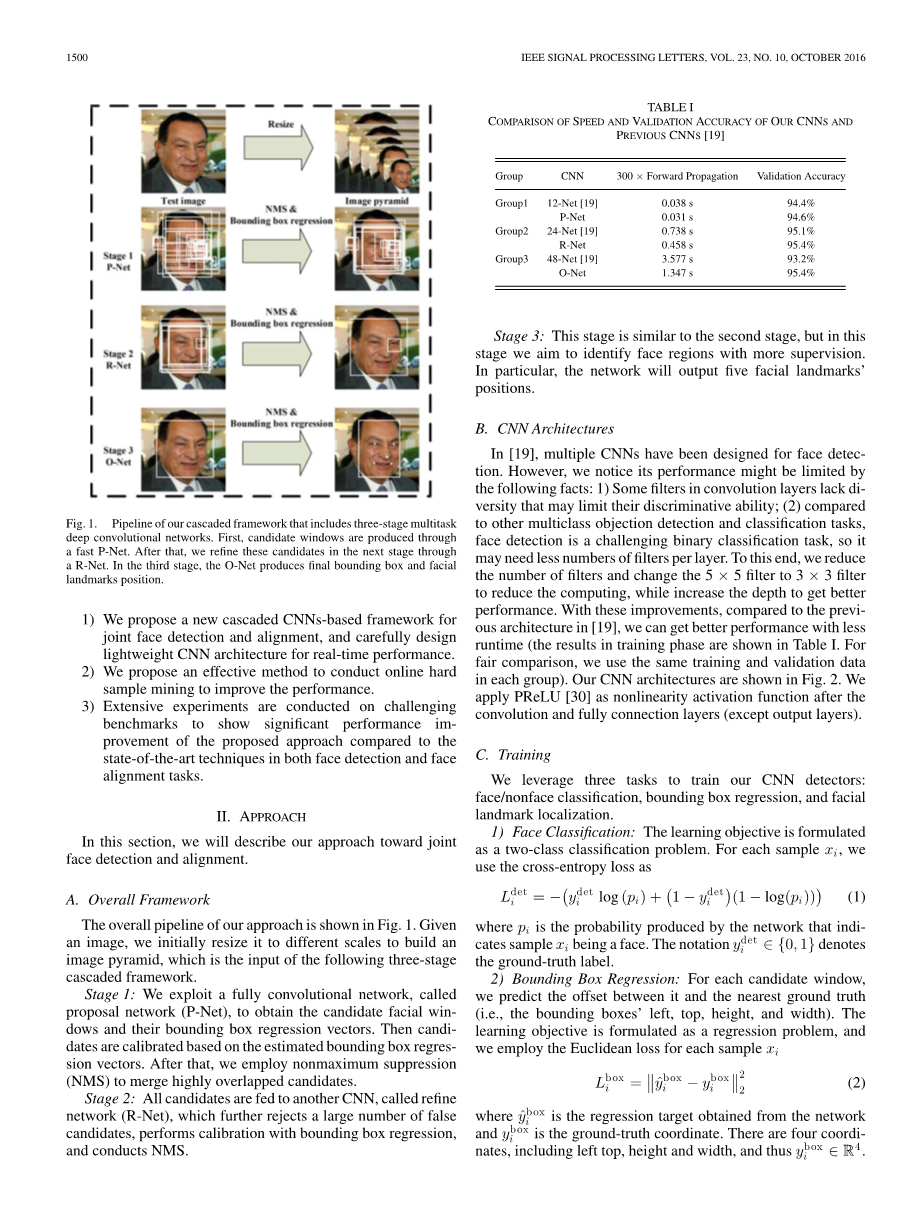

我们的方法的整体流程如图1所示。给定一个图像,我们首先将其调整到不同的比例,以构建一个图像金字塔作为以下三级框架的输入。

图1. 我们的级联框架的流程,包括三阶段多任务深度卷积网络。首先,候选窗口是通过快速的P-Net生成的。在此之后,我们将在下一阶段通过R-Net来完善这些候选项。在第三阶段,O-Net生成最后的边界框和人脸关键点位置。

阶段1:我们利用一个完全卷积网络(P-Net)来获得候选的人脸和它们的边界框回归向量。然后根据估计的边界框回归向量对候选对象进行标定。然后,我们使用非最大抑制(NMS)合并高度重叠的候选对象。

阶段2:所有候选对象都被提供给另一个CNN,称为精炼网络(R-Net),该CNN进一步拒绝大量错误候选对象,使用边界框回归进行校准,并执行NMS。

阶段3:这一阶段与第二阶段相似,但在这一阶段我们的目标是识别具有更多监管的人脸区域。特别地,网络将输出五个人脸关键点的位置。

B. CNN的架构

在文献[19]中为人脸检测设计了多个CNNs。然而,我们注意到它的性能可能会受到以下现实的限制:(1) 卷积层中的一些滤波器缺乏多样性,可能会限制其识别能力;(2) 与其他多类目标检测和分类任务相比,人脸检测是一项具有挑战性的二元分类任务,每一层可能需要较少的滤波器数量。为此,我们减少过滤器,将5times;5过滤器改为3times;3过滤器来减少计算,同时增加深度获得更好的性能。通过这些改进,与文献[19]中以前的体系结构相比,我们可以用更少的运行时间获得更好的性能(训练阶段的结果如表1所示,为了公平比较,我们在每组中使用相同的训练和验证数据)。我们的CNN架构如图2所示。在卷积和全连接层(输出层除外)之后,我们将PReLU作为非线性激活函数。

表1. 我们的CNNs和之前的CNNs的速度和验证精度的比较

|

组 |

CNN |

300*正向传播 |

验证精度 |

|

组1 |

12-Net [19] |

0.038 s |

94.4% |

|

P-Net |

0.031 s |

94.6% |

|

|

组2 |

12-Net [19] |

0.738 s |

95.1% |

|

R-Net |

0.458 s |

95.4% |

|

|

组3 |

12-Net [19] |

3.577 s |

93.2% |

|

O-Net |

1.347 s |

95.4% |

图2. P-Net、R-Net和O-Net体系结构,其中“MP”表示最大池化,“Conv”表示卷积。卷积和池的步长分别为1和2。

C. 训练

我们利用三个任务来训练我们的CNN检测器:人脸/非人脸分类、边界框回归和人脸标志定位。

1) 人脸分类:学习目标为两类分类问题。对于每个样本xi,我们使用交叉熵作为

(1)

其中,pi是网络产生的表示样本xi是人脸的概率。符号yidetisin;{0,1}表示真实的标签。

2) 边界框回归:对于每个候选窗口,我们预测它与最近的标定过的真实数据(即边框的左边、顶部、高度和宽度)。学习目标是一个回归问题,我们使用每个样本xi的欧几里德损失

(2)

其中,是从网络获得的回归目标,是真实坐标。有四个坐标,包括左顶点、高度和宽度,因此。

3) 人脸地标定位:与边界框回归任务类似,将人脸关键点检测作为回归问题,将欧氏损失最小化为

(3)

其中,是从网络获得的人脸关键点的坐标,是第i个样本的真实坐标。有五个人脸关键点,包括左眼、右眼、鼻子、左嘴角、右嘴角,因此。

4) 多源训练:由于我们在每个CNN中使用不同的任务,所以在学习过程中会有不同类型的训练图像,如人脸、非人脸、部分对齐的人脸。在这种情况下,一些损失函数[即(1)-(3)]不使用。例如,对于背景区域的样本,我们只计算,其他两个损失设为0。这可以通过样本类型指示器直接实现。那么,整体的学习目标可以表述为

(4)

其中N是训练样本的数量,表示任务的重要性。我们在P-Net和R-Net中使用,而在O-Net中使用使人脸关键点定位更准确。是样本类型指示器。在这种情况下,使用随机梯度下降法训练这些CNNs是很自然的。

5) 在线硬样本挖掘:不同于传统的硬样本挖掘,我们在人脸/非人脸分类任务中进行在线硬样本挖掘,这与训练过程相适应。

特别地,在每个小批量中,我们对所有样本的正向传播计算的损失进行排序,并将前70%作为硬样本。然后,我们只计算反向传播中这些硬样本的梯度。这意味着我们忽略了在训练过程中对增强检测器帮助不大的简单样本。实验表明,该策略在不需要人工选择样本的情况下,具有较好的性能。第3节证明了它的有效性。

3 实验

在本节中,我们首先评估了提出的硬样本挖掘策略的有效性。然后,我们将我们的人脸检测器和对准方法与人脸检测数据集和基准库(FDDB)、WIDER FACE以及户外基准库中的带标记的人脸关键点(AFLW)中的最新方法进行比较。FDDB数据集包含一组2845张图像的5171个人脸标记。WIDER FACE数据集包括32203张图像的393703个已标记人脸边界框,其中50%用于测试(根据难度分为三个子集的图像),40%用于训练,其余用于验证。AFLW包含24396个人脸的人脸关键点标记,我们使用与文献[22]相同的测试子集。最后,我们评估我们的人脸检测器的计算效率。

A. 训练数据

因为我们同时进行人脸检测和定位,我们在训练过程中使用了以下四种不同的数据标记:

- negatives:对比真实人脸,交并比(IoU)小于0.3的区域;

- positives:对比真实人脸,交并比大于0.65的区域;

- part faces:交并比介于0.4和0.65之间;以及

- landmark faces:标记出五个人脸关键点的人脸

在part faces和negatives有不清晰的差距,还有不同人脸标记之间的差异。所以,我们选择介于0.3和0.4的交互比。negatives 和 positives用于人脸分类任务,positives 和 part faces用于边界框回归,landmark faces用于定位人脸标志。总训练数据构成为3:1:1:2(negatives/positives/part face/landmark face)。每个网络的训练数据收集描述如下:

- P-Net:我们随机地从WIDER FACE采集数据作为positives、negatives、part face。然后,我们从 CelebA采集人脸作为标志人脸。

- R-Net:我们使用我们的框架的第一阶段来检测从WIDER FACE采集的positives、negatives、part face,以及从CelebA采集的标志人脸。

- O-Net:类似于R-Net收集数据,但是我们使用我们的框架的前两个阶段来检测人脸和收集数据。

B. 在线硬样本挖掘的有效性

为了评估所提出的在线硬样本挖掘策略的贡献,我们训练了两个P-Net(有和无在线硬样本挖掘),并比较了它们在FDDB上的性能。图3(a)显示了FDDB上两个不同的P-Net的结果。显然,在线硬样本挖掘有助于提高性能。在FDDB上可以获得1.5%以上的性能改进。

C. 联合检测和对齐的有效性

为了评估联合检测和校准的作用,我们评估两种不同的O-Nets的性能(联合人脸关键点回归学习和不联合)在FDDB(相同的P-Net和R-Net)。我们也比较在这两种O-Nets中边界框回归的性能。图3(b)表明,联合关键点定位任务学习有助于

剩余内容已隐藏,支付完成后下载完整资料

资料编号:[18339],资料为PDF文档或Word文档,PDF文档可免费转换为Word